PSE

Die Projektergebnisse der einzelnen Gruppen

Projektbeschreibung

Projektbeschreibung

IoT für einen smarten Fahrradverkehr

Das Internet der Dinge (Internet of Things, IoT) ist Realität. Die Anzahl verbundener Endgeräte wird nach Vorhersagen in 2021 bis zu 25 Milliarden Geräte erreichen. Der Automobilbereich prägt durch Schlagworte wie Car To Car (C2C Communication) und autonomes Fahren die Begriffswelt. Darmstadt als erste Digitalstadt Deutschlands möchte mit dem IoT und hierfür geschaffenen Netzwerken zu einer echten Smart City werden. Durch die Verkleinerung der Hardware von IoT-Geräten lassen sich mittlerweile auch Fahrräder ausstatten und vernetzen. So ließe sich in Zukunft in einer Stadt der Fahrradverkehr smarter und flüssiger gestalten.

In unserem Systemprojekt wollen wir die Frage untersuchen, mit welchen heutigen Methoden der grafischen Datenverarbeitung sowie mit welcher Hardware sich die Dynamik einer Massenpanik automatisiert erkennen lässt. Motiviert ist die Fragestellung durch immer wieder vorkommende Katastrophen, die durch die Dynamik in einer Masse und von Menschen durch äußere Anlässe oder von selbst entstehen. Eine automatische Erkennung ließe es zu, dass im weiteren gezielte Verhaltenshinweise gegeben werden, die Menschenleben retten können. Hierzu wollen wir in Projektform unterschiedliche Fragestellungen untersuchen:

- Wie lassen sich in einer Menschenmenge einzelne Personen und ihre Bewegung automatisch erkennen?

Hierzu bieten sich unterschiedliche bekannte Algorithmen zur Verarbeitung von Bildern an, die sich praktisch bewerten lassen.

- Lässt sich eine Erkennung realisieren, bei der einzelne Personen nicht mehr unterscheidbar sind?

Schwierigkeiten bei der Erkennung kann es durch größere Entfernungen aber auch durch einen schrägen Blickwinkel oder auch den Blick senkrecht von oben geben.

- Welche Hardware ist geeignet, um eine Erkennung möglich zu machen?

Kamerabilder bieten mittlerweile hohe Auflösungen zu geringen Preisen. Je nach Entfernung von der Menschenmenge und der Anzahl von Kameras lassen sich Bilddaten unterschiedlicher Güte zur weiteren Verarbeitung erzeugen. Weiterhin können alternativ zur Aufnahme im sichtbaren Lichtbereich auch Wärmebildkameras eingesetzt werden. Mittlerweile gibt es auch Radarsensoren, die bei näheren Entfernungen Bewegungen detektieren können. Ein Kombination unterschiedlicher Hardware könnte bessere Ergebnisse liefern.

- Wie sicher lässt sich eine Massenpanik anhand der heute bekannten Ansätze erkennen?

Die Erkennnung von Personen und deren Bewegung kann die Grundlage bieten. Allerdings spielen auch Faktoren wie der Abstand der Personen untereinander und äußere Anlässe eine Rolle bei der Entstehung.

Je nach Anzahl der Teilnehmenden können mehrere Fragestellungen und Ansätze durch kleinere Teams untersucht werden.

Fahrräder als Gruppe

Die Optimierung des gesamten Verkehrs für einzelne Fahrräder führt zur Benachteiligung aller anderen Verkehrsteilnehmer. Eine Idee wäre, dass mehrere Fahrradfahrer eine Gruppe bilden. Wenn solch einer Gruppe in einer smarten Verkehrssteuerung Vorrang eingeräumt wird, wäre die Akzeptanz bei den anderen Verkehrsteilnehmern für die Gewährung eines Vorrangs deutlich größer. Hierzu könnten die miteinander vernetzten Fahrräder beispielsweise mittels einer Bike 2 Bike Communication (B2B-C) in Kontakt treten und untereinander kommunizieren. Kleine IoT-Geräte mit integriertem Nahfunk können andere Geräte in der Nähe erkennen und so zu einer Gruppe werden. Das in Darmstadt im Rahmen der Aktivitäten zur ersten Digitalstadt Deutschlands installierte LoRaWAN-Netzwerk kann als Weitfunknetz deutlich über den Stadtbereich hinausreichend Signale der kleinen IoT-Geräte empfangen.

Kontakt

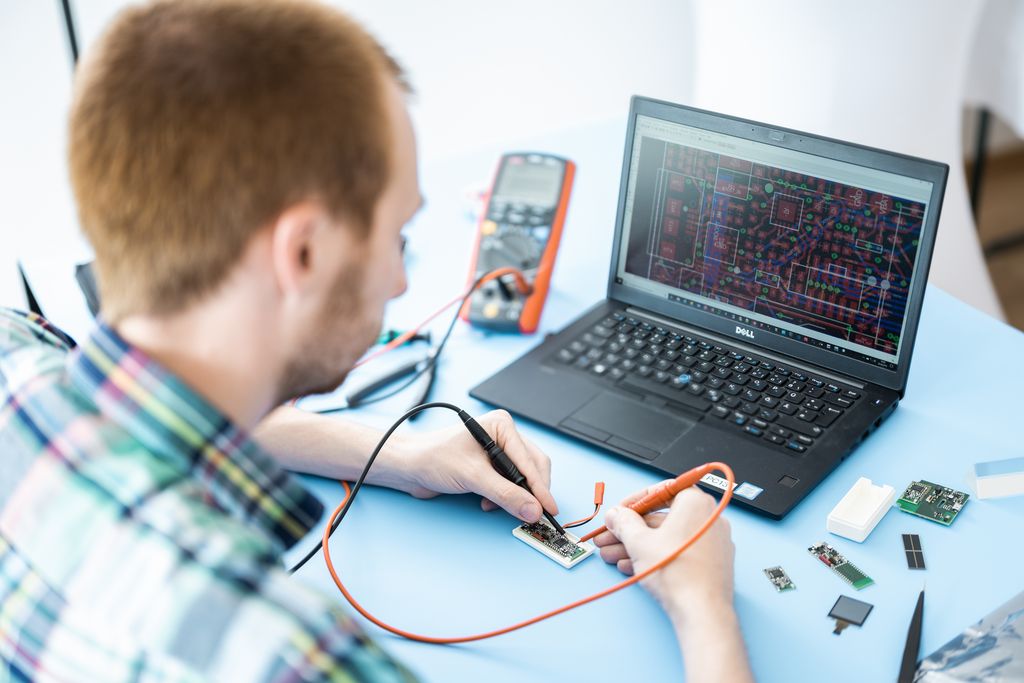

Prototyping mit IoT-Geräten

In unserem Projekt wollen wir Prototypen für B2B-C Geräte auf Basis von IoT-Boards entwickeln. Hierbei werden wir durch das Unternehmen Arnold Zender Elektronik unterstützt, die für das Systemprojekt angepasste Hardware erstellen kann. Dies erlaubt es, auch das Format so zu wählen, dass es sich gut für Fahrräder anpassen lässt. Weiterhin steht auch ein 3D-Drucker zur Verfügung, um angepasste Gehäuse zu drucken.

Die Projektergebnisse der einzelnen Gruppen

PanicSim - Simulieren von Menschenmassen

Gruppe 1

Ziel war das Erstellen von Software, welche eine Menschenmasse, in Form von entsprechenden Bewegungs- und Vitaldaten, simuliert.

R2M2 v2 - Roboter-Roboter-Mensch-Motion - Projektbeschreibung

Aktuelle Robotersysteme werden immer intelligenter. Die hierfür verwendeten eingebetteten Systeme verfügen über deutlich bessere technische Fähigkeiten, so dass sich eine abstraktere Programmierung komplexer Bewegungssteuerungen verbunden mit einer Vielfalt von sensorischen Fähigkeiten erreichen lässt. Die Interaktion zwischen Menschen und Robotern sowie von Robotern untereinander tritt damit immer mehr als Experimentierfeld für zukünftige Anwendungen in den Vordergrund.

Von der kreativen Idee zum Projekt

Zu Beginn des Projekts wird das Ziel und die Architektur für eine B2B-Kommunikation entworfen. Aus der vagen Idee, die ihr mit eurer Kreativität beliebig anreichern könnt, erarbeitet ihr zusammen im Projektteam das Ziel des Projekts in Absprache mit dem Dozenten. Im weiteren Verlauf wird die Zeit des Projektverlaufs in Sprints nach agiler Vorgehensweise aufgeteilt. Ihr definiert zu erreichende Zwischenziele. Als Betreuer übernehmen wir dabei die Rolle des Auftraggebers. Wahrscheinlich werdet ihr während des Projektverlaufs Änderungsbedarf erkennen, den ihr mit uns als Auftraggeber abstimmt und so einen typischen Projektverlauf einer Produktentwicklung übt.

Interaktionsfelder Roboter-Roboter und Mensch-Roboter

Im Rahmen einer Maßnahme zur Qualitätssteigerung der Lehre stehen uns unterschiedliche Robotersysteme zur Verfügung, mit denen wir in einem Vorgängerprojekt erste Ergebnisse erzielt haben (siehe Videos!).

Wir wollen nun im kommenden Systemprojekt weitere spannende Interaktionsfelder zwischen Roboter und Mensch bzw. zwischen Robotern untereinander schaffen und erforschen. Insbesondere können wir in diesem Umfeld die Möglichkeiten von Computer Vision und die von Motion Control zur Steuerung der Roboter untersuchen.

Video Gruppe 1 Nao Video Gruppe 2 Nao Video Gruppe Sphero Video Gruppe Cozmo

Vorkenntnisse

Gute Programmierkenntnisse insbesondere in C/C++, Grundlagenveranstaltungen der Technischen Informatik (TGI, RA, MPS). Hilfreich sind Kenntnisse aus der Lehrveranstaltung „Softwareentwicklung für Embedded Systeme“ sowie ein Interesse für Entwicklung von Embedded Systemen, IoT-Anwendungen und Technologien für eine nachhaltige Stadtentwicklung.

Dozent

Prof. Dr. Jens-Peter Akelbein

unterstützt durch

Mario Hoss - wissenschaftl. Mitarbeiter

Bettina Kurz - wissenschaftl. Mitarbeiterin und Laboringenieurin Emb. Systeme

sowie Unternehmensunterstützung von

Arnold Zender Elektronik vertreten durch Alexander Zender

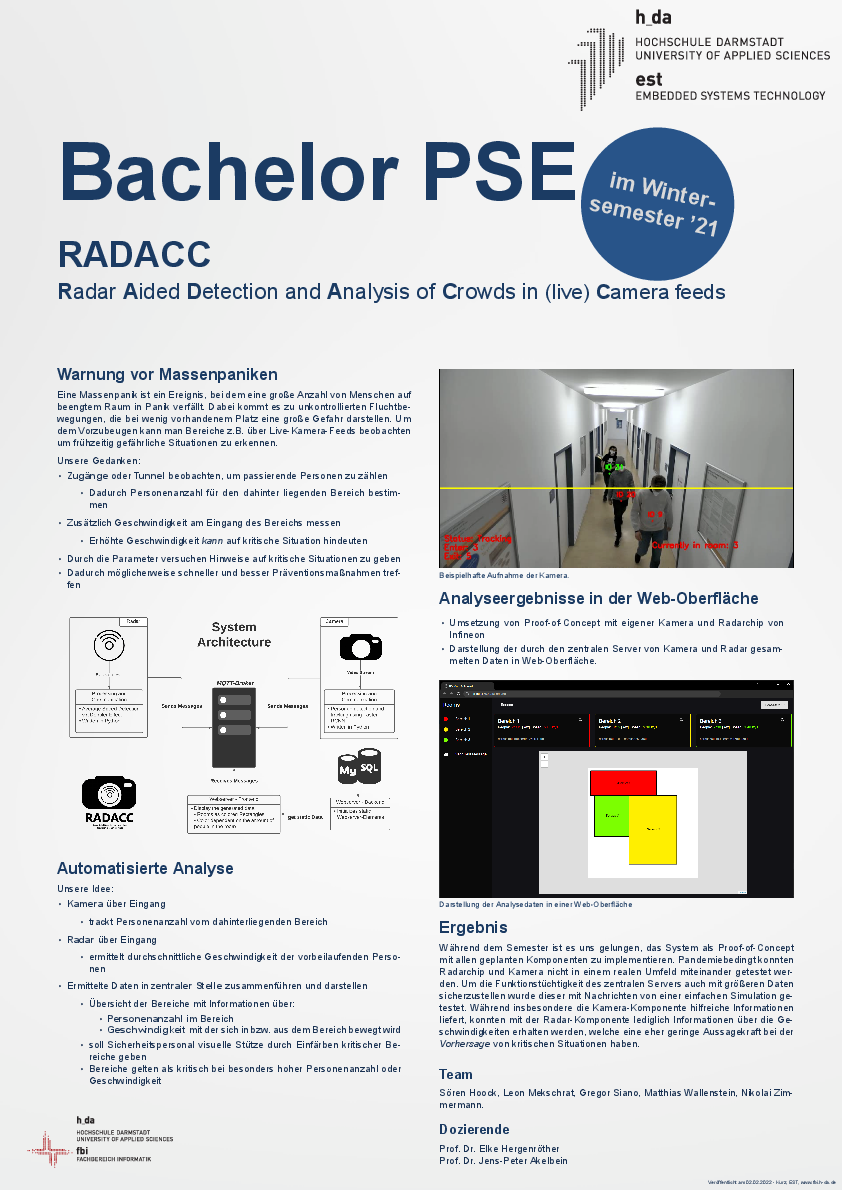

RADACC - Radar Aided Detection and Analysis of Crowds in (live) Camera feeds

Gruppe 2

Ziel war das Erstellen von Software zur Warnung vor Massenpaniken.

Wir freuen uns auf ein spannendes Projekt mit Ihnen!

Die Roboter

Zur Verfügung haben wir eine Vielzahl von Robotern mit sehr unterschiedlichen Eigenschaften. Mit zwei humanoiden NAO-Robotersystemen, die bereits mit einer Vielzahl von Sensoren (u.a. zwei HD-Kameras) ausgestattet sind, können wir die Interaktion mit humanoiden Systemen erproben.

Motion und Interaktion

Als ersten Themenschwerpunkt wollen wir die Bewegungseigenschaften der Roboter näher untersuchen und optimieren. Hierzu sollen die mitgelieferten Fähigkeiten analysiert und durch eigene Software ergänzt oder ersetzt werden. Als zweiten Schwerpunkt wollen wir die Interaktionsmöglichkeiten mit Menschen und anderen Robotern sowie mit der Umwelt wie dem jeweiligen Raum verbessern.Neben den bereits im Robotersystem verbauten Kameras könnten auch weitere externe Kameras zum Einsatz kommen. Zu Beginn stellen wir Ihnen im Kickoff eine Reihe von Ideen vor, aus denen Sie Ihre eigenen Zielvorgaben und Realisierungen entwickeln werden.

Kickoff und Vorbereitungsphase

In einem Kick Off stellen wir zu Beginn unterschiedliche Ideen für Szenarien mit Robotern vor und diskutieren diese. Weiterhin geben wir Informationen über den weiteren Ablauf und die zur Verfügung stehende Hardware sowie ausgewählte Vorgehensweisen aus SCRUM als Projektvorgabe. Die folgenden Tage nutzen Sie zur fachlichen Vorbereitung und analysieren die Realisierungsmöglichkeiten. Hieraus entwickeln Sie Ihr Projektziel und -plan in Form einer Präsentation.

Dafür wären Projektziele, deren Ergebnisse sich später bei passender Gelegenheit den Besuchern unseres Fachbereichs demonstrieren ließen, besonders geeignet.

Blockphase als Vollzeit-Projekt

Mit der Präsentation der Projektziele starten wir die Blockphase, in der Sie an allen Tagen in Vollzeit (8h/Wochentag) im Projekt arbeiten. Wir übernehmen dabei die Rolle des Auftragsgebers. Wie in der Praxis üblich, muss ein während des Projekts entstehender Änderungsbedarf mit uns als Auftraggebern abgestimmt werden. Das Projektergebnis wird im Rahmen einer Abschlusspräsentation vorgestellt.

Vorkenntnisse

Mindestens voraussetzend sind gute Programmierkenntnisse und Grundlagen der Grafischen Datenverarbeitung. Außerdem sind Kenntnisse in Softwareentwicklung für Embedded Systeme oder Grundlagen der Robotik von Vorteil.

Die Termine

Blockveranstaltung am Ende der vorlesungsfreien Zeit im September!

Kickoff-Veranstaltung: 27.08.19

Blockphase: 09.-20.09.19

Abschlusspräsentation: 26.09.19

Die Dozenten

Prof. Dr. Elke Hergenröther - Visual Computing und Grundlagen der Informatik

Prof. Dr. Thomas Horsch - Technische Informatik und Grundlagen der Informatik, Robotik

Prof. Dr. Jens-Peter Akelbein - Technische Informatik und Softwaretechnik, Embedded Systeme, IoT

unterstützt durch

Rudi Scheitler - Laboringenieur Robotik

Mario Hoss - wissenschaftl. Mitarbeiter

Bettina Kurz - wissenschaftl. Mitarbeiter und Laboringenieurin Emb. Systeme

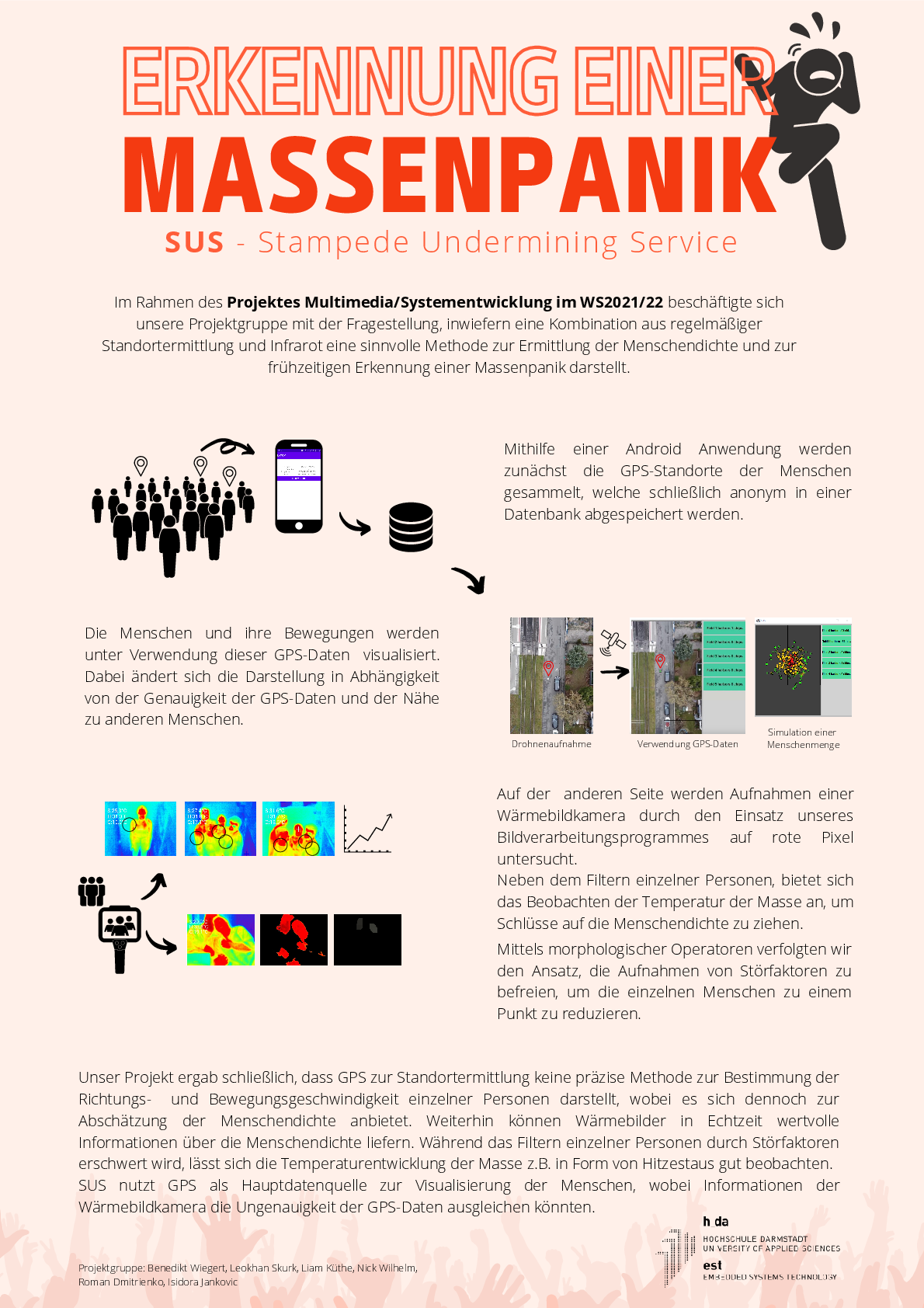

SUS - Stampede Undermining Service

Im Rahmen des Projektes beschäftigte sich diese Projektgruppe mit der Fragestellung, inwiefern eine Kombination aus regelmäßiger Standortermittlung und Infrarot eine sinnvolle Methode zur Ermittlung der Menschendichte und zurfrühzeitigen Erkennung einer Massenpanik darstellt.

Ergebnisse Gruppen 1 + 2

Gruppen-Ziele mit humanoidem Roboter NAO und Sphero SPRK+

- NAO erkennt,lokalisiert und verfolgt Sphero

- NAO erkennt Farben und Gesten von Sphero...

- ... und führt anhand Dieser verschiedene Aktionen durch

Gruppe 1 hat die zusätzliche Anforderung, dass die NAO eigene Kamera nicht verwendet werden kann.

Ergebnis Gruppe 3

Das Projektziel der Gruppe 3 des R2M2 Projekts ist es, den Sphero SPRK+ mittels iOS Augmented Reality App zu steuern. Der Sphero SPRK+ soll nach einer Touch Geste in der iOS App auf einen Platz in den Raum fahren. Die Augmented Reality Eigenschaft wird mittels Apples ARKit erreicht. Diese ARKit bietet die Möglichkeit, ein Koordinatensystem mit Planes zu erstellen und Objekte zu erkennen/tracken.

Ergebnis Gruppe 4

Anki Cozmo als Coztbote

Die Idee ist die Simulation einer Stadt, in der Postpakete ausgeliefert werden müssen. Hierzu werden bestimmte Stellen in der Stadt als Häuser markiert und eine Stelle wird als Paketlager bestimmt. Die Aufgabe des Roboters ist es dann, die Pakete beim richtigen Haus abzuliefern.

Die Zuordnung von Paketen zu Häusern wird mittels Gesichtserkennung umgesetzt: sowohl auf den Würfeln (den Paketen) als auch auf den Häusern werden Fotos mit Gesichtern angebracht.

Es stellte sich heraus, dass man die Gesichter nicht auf die Würfel kleben muss, sondern der Roboter sich die Gesichter merkt und sie einem bestimmten Würfel (Paket) dauerhaft zuordnen kann.

Kontakt

Prof. Dr. Jens-Peter Akelbein