Archiv: frühere Bachelor Projekt Systementwicklung

Datensammlung und Machine Learning (ML)

Wintersemester 2022/23: Astronomie und maschinelles Lernen

Im Wintersemester 2022/23 ist unser Thema Astronomie und Maschinelles Lernen.

Je nach Interesse in der Gruppe können unterschiedliche Projekte bearbeitet werden, alle Themen drehen sich dieses Mal um Astronomie. Je nach Teilnehmerzahl streben wir eines, zwei oder alle drei Themen an. Welche das sind, legen wir zu Beginn der Veranstaltung gemeinsam fest.

Sie werden betreut von Kilian Schwarz, Reiner Wichert und Stefan Rapp. Als Kooperationspartner und Fachexperten konnten wir wieder Matthias Hoeft von der Landessternwarte Tautenburg gewinnen.

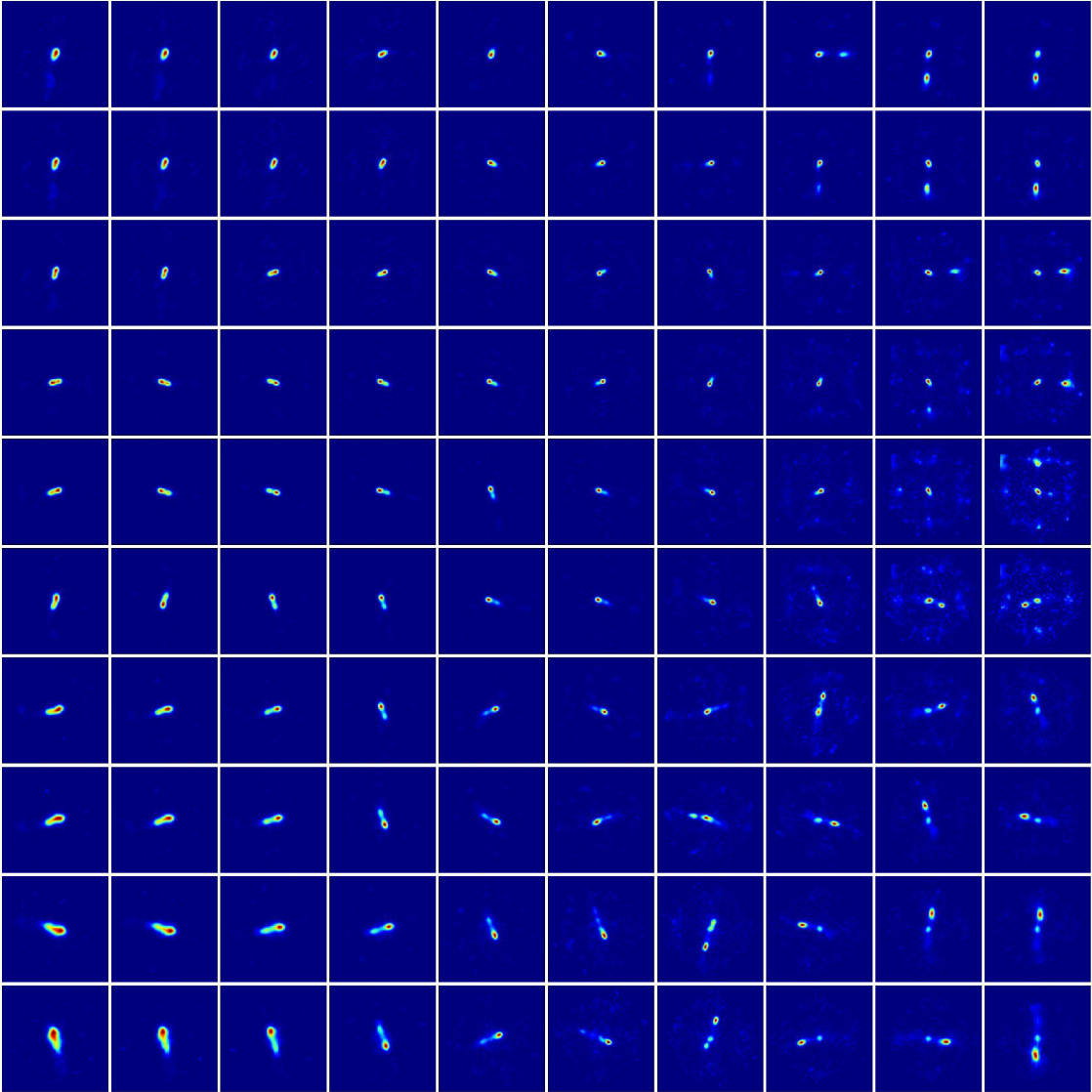

1. Im letzten Wintersemester wurden im Projekt Data Science auf Radioastronomiedaten Kohonenmaps trainiert, auch Selforganizing Maps (SOM) genannt. Wir konnten ausgehend von Radioastronomiedaten (LoTSS Data Release 1) Galaxien automatisch nach ihrer Erscheinung (die sogenannte Morphologie) sortieren und 'interessante' Erscheinungen von 'langweiligen' punktförmigen Galaxien trennen, siehe das Bild oben. Aufbauend auf die dort entwickelten Skripte wollen wir unsere Analysen mit weiteren Daten verfeinern und die verwendete Analysesoftware PINK erweitern: Mittlerweile sind weitere Daten verfügbar (LoTSS Data Release 2), aus denen wir weitere spannende Galaxien entdecken wollen. PINK ist ein in C++ und CUDA geschreibenes Programm, das die SOMs aus ausgeschnittenen Bilddaten generiert. Dabei wird in einem Training von neuronalen Netzen versucht, ähnliche Bilder zu sogenannten Knoten zusammenzufassen, die durch ein Bild repräsentiert sind. Das Training ist unüberwacht, das heißt, wir müssen die Bilder nicht erst aufwändig labeln, sondern die SOM wird nur anhand der Ähnlichkeit der Bilder erstellt. PINK kann dabei die Bilder der Galaxien drehen, um eine möglichst gute Übereinstimmung zu finden. Allerdings ist bei Bildern, die mehrere Intensitätsmaxima haben, der Abstand nicht normiert. Wir wollen im Projekt PINK so erweitern, dass nicht nur die Rotation sondern auch die Skalierung in bestimmten Grenzen angepasst wird, um bessere Cluster mit spannenderen Morphologien zu erzielen. Je nach Interesse besteht dabei die Möglichkeit, in die CUDA-Programmierung auf Nvidia-Grafikkarten einzusteigen oder auch beim bekannten C++ zu verbleiben.

2. Überprüfung eines 'Citizen Science' Projekts mit SOM. In einem Citizen Science Projekt (Freiwillige normale Bürger helfen bei der Analyse von wissenschaftlichen Daten mit) sollen Radioastronomiedaten bearbeitet werden. Eine Mitarbeiterin der Landessternwarte ist in dieses Projekt involviert. Wir wollen mit Hilfe der SOM die Ergebnisse der Laien überprüfen, indem wir die Ergebnisse clustern. Auf diese Art und Weise kann eine Qualitätskontrolle aufgebaut werden, bei der ungewöhnliche und möglicherweise falsche Analysen durch die Laien automatisiert aussortiert werden um gegebenenfalls von Experten angeschaut werden zu können. Wir sind hier also in aktuelle Forschungsarbeiten eingebunden. Als Werkzeug wollen wir ebenfalls PINK verwenden, wobei hier mehr die reine Anwendung von PINK im Vordergrund steht, und nicht die Erweiterung. Es ist zu erwarten, dass wir dafür mehr für die Konvertierung und Aufbereitung der Daten programmieren müssen, da wir hier noch keine fertigen Konvertierungsskripte haben.

3. Erstellung von Bildern mit eigener Ausrüstung. Bei diesem Projekt wollen wir ganz praktisch werden. Das Bild oben ist die Aufnahme der Andromedagalaxie mit seiner Begleitgalaxie Messier 32, von Reiner Wichert aus 22 selbst aufgenommenen Bildern zusammengesetzt. Dazu braucht man eine Kamera mit Teleobjektiv und eine motorisch angetriebene Nachführung, die den Bewegungen der Sterne folgt und somit lange Belichtungszeiten ermöglicht. Wir wollen so eine Nachführung im Projekt bauen, dazu müssen wir die Mechanik mit dem 3D-Drucker erstellen, Schrittmotoren mit Arduino, ESP-32 oder Raspberry Pi ansteuern und dann eigene Aufnahmen machen und die (verrauschten) Einzelbilder per Software überlagern und dadurch zu entrauschen. Alternativ können wir eine digitale (schwere) Spiegelreflexkamera oder den (viel leichteren) 12,3 Megapixel Sensor für den Raspberry Pi einsetzen. Gegebenenfalls werden wir eine Exkursion unternehmen, um der Lichtverschmutzung um Darmstadt herum zu entkommen und einen höheren Standpunkt mit weniger atmosphärischen Störungen zu bekommen. Als Fallback steht uns das Equipment von Prof. Wichert zur Verfügung.

Sommersemester 2021

In diesem Semester befassen wir uns mit drei Projekten:

1. Erkennung von Maschinenbauteilen

(Kooperationspartner DEMA GmbH, Frederic Ludley)

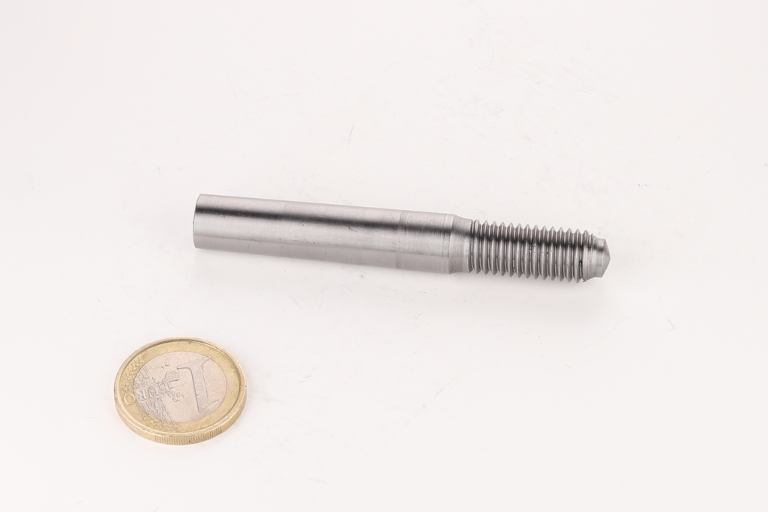

Im letzten Semester haben wir mit der Photobox im Graphilklabor und mit Smartphones hauptsächlich Daten gesammelt und erste Versuche unternommen, die Maschinenbauteile mit Tensorflow / Keras zu erkennen. Die besondere Herausforderung hier besteht nicht nur darin, die jeweilige Teileart zu erkennen sondern insbesondere die Größe. Dazu sind in den Bildern Referenzobjekte vorhanden: kariertes Papier A4, eine Euromünze oder ein auf A5 gefaltetes weißes Blatt Papier. Aufgaben dieses Semester werden sein

- Automatisiertes Ausschneiden der Objekte zur Verbesserung des Trainings

- Extraktion von Merkmalen des Referenzobjekts zur Skalierung der Pixelgröße

- Experimente zu verschiedenen Klassifikationsstrategien zur Verbesserung der Größenerkennung

- Erkennung morphologischer Strukturen, z.B. Anzahl der Gewindegänge, unterschiedliche Endbearbeitungen als getrennter Erkennungsschritt

Teilnehmer sollten insbesondere Interesse an Maschinellem Lernen, Computer Vision, Freude an gründlichem und sorgfältigen Arbeiten und ggfs. auch Affinität zum Maschinenbau mitbringen.

2. Transformation geographischer Datensätze

(Kooperationpartner Pflug GmbH, Volker Paasch)

Dieses neue Themengebiet befasst sich mit der Datenkonvertierung (insbesondere Koordinatentransformationen und Interpolationen) von Geographischen Daten für die Erstellung von Landschaftsmodellen und Reliefgloben. Die Fa. Pflug stellt seit vielen Jahren Geländemodelle zum Beispiel für Museen in CNC Frästechnik her. Sie ist auch Hersteller des weltweit genauesten Modells des Mondes mit 3.5m Durchmesser. Die Aufbereitung der Daten die z.B. aus Satelittenmissionen gewonnen werden oder von Landesvermessungsämtern zur Verfügung gestellt werden, und diese in Fräsprogramme für die CNC-Maschinen zu übersetzten ist eine mühsame Aufgabe, die wir im Projekt gemeinsam mit einem Programm automatisieren wollen.

- Verarbeiten von Geo-TIFF Bildern

- Verarbeiten von Daten zu unterschiedlichen Kugelmodellen (Geoiden, WGS84)

- Aufteilung der Daten von Globen in Teile (Ikosaederstumpfe o.ä.)

- Interpolation auf andere Stützstellenabstände / Fräsergrößen

- Integration in ein Qt-Programm, das von 'Powerusern' ohne Programmierkenntnisse bedient werden kann

Teilnehmer sollten Mathematisches Verständnis, insbesondere Lineare Algebra und Koordinatensysteme, Interpolation von Daten mitbringen und idealerweise Interesse an Geographie und/oder CNC Frästechnik besitzen. WIr wollen ein Programm entwickeln, das auch Fragen der Usability umfasst -- also werden auch Fragen der UI-Gestaltung und das Softwareengineering nicht zu kurz kommen.

3. Erkennung von Wildtieren in Aufnahmen einer Wildtierkamera

(Kooperationspartner fbmn, Prof. Torsten Strempel)

In diesem Projekt geht es um die Erkennung von Wildtieren wie Rehen, Füchsen, Hasen und so weiter in Bildern einer Wildkamera im Spessart.

- Aufbereiten und Kategorisieren der Daten (Tag-, Nachtaufnahmen)

- Labeling der Daten

- Experimente mit unterschiedlichen Lernverfahren und Netzwerktopologien

- ggfs. Erweiterung von Bildern auf die Videosequenzen der Kamera

Teilnehmer sollten Interesse an Maschinellem Lernen und sorgfältigem und systematischem Arbeiten mit großen Datenmengen mitbringen.

Interdisziplinarität

Das Projekt mit den Wildtieren ist ursprünglich für Mathematikstudierende im Master ausgeschrieben, die Beteiligung von Informatiker:innen ist bei Interesse aber durchaus auch erwünscht. Im Gegenzug sollen die Mathematiker:innen sich bei Interesse auch in die anderen beiden Projekte einbringen können. So können die jeweiligen Disziplinen Ihre Expertise einbringen, und wir üben alle das respektvolle Zusammenarbeiten in interdisziplinären Teams.

Die Lehrveranstaltung wird dazu gemeinsam von Torsten Strempel von der Mathematik und Stefan Rapp von der Informatik betreut. Die Teilnehmer erhalten die Studienleistung im jeweiligen Fach anerkannt, der Umfang der Leistungen (CP) kann dabei variieren.

Wintersemester 2020/21

In der Veranstaltung befassen wir uns mit verschiedenen Anwendungen von Machine Learning (ML), und insbesondere mit der Datensammlung für das Maschinelle Lernen.

Wir wollen uns mit Datensammlung und dem Entwickeln einer ML-Anwendung befassen. Dazu werden wir in kleineren Teams (ca. 3-4 Teilnehmer) zusammenarbeiten, die gemeinschaftlich die Datensammlung, Datenaufbereitung, das Training von Klassifikatoren, die Evaluation der Ergebnisse und die Aufbereitung der Ergebnisse eigenverantwortlich leisten. Dabei sind die Kleingruppen mit unterschiedlichen Aufgabenstellungen befasst. Die Anzahl der Aufgabenstellungen ist von der Teilnehmerzahl abhängig und folgt einer Priorisierung, nach Möglichkeit gehen wir auf individuelle Neigungen ein, Sie müssen aber auch bereit sein, ein zugewiesenes Thema zu bearbeiten. Da das Training von ML-Verfahren oft viel Rechenleistung und auch allerhand Daten benötigt, schadet es nicht / ist es bequemer, wenn Sie zuhause einen PC mit viel Speicher, Grafikkarte und Plattenplatz haben. Wir haben einen solchen Rechner im Labor und gegebenenfalls eingeschränkt Zugriff auf weitere Rechner.

1. Themengebiet: Erkennung von Normteilen für den Maschinenbau

Im Maschinenbau gibt es standardisierte Bauteile, die immer wieder in Maschinen und im Formenbau verwendet werden. Wir haben einen Kontakt zu einem Hersteller solcher Normteile, der uns Beispielteile zur Verfügung gestellt hat.

Ziel ist es, die Form (also die DIN- oder ISO-Norm, DIN 7, DIN 7979, ISO 8737 etc.) als auch die Größe (z.B. Durchmesser 6 mm, 40 mm lang) zu erkennen. Die Bauteile sind unterschiedlich leicht voneinander zu unterscheiden und es gibt sie in fest vorgegebenen, abgestuften Größen. Wir befassen uns im Wesentlichen mit sogenannten Stiften, die es in unterschiedlichen Endbearbeitungen gibt (Linsenkuppen, Kegelkuppen, ohne Kuppen, mit Bohrung und Innengewinde, mit Außengewinde etc).

- Systematischer Aufbau einer Datensammlung der Bauteile mit der Photobox im Graphiklabor

- Unterschiedliche Größenreferenzen: Kariertes Blatt Papier, Münze

- Training eines Klassifikators

- Erkennung direkt der Art (Norm) als Ganzes oder der Morphologie, also einzelne Eigenschaften (welche Endbearbeitung, mit Innen-/Außengewinde etc.)

- Erkennung der Größe (Die Teile gibt es nur in 'diskreten' Größen, z.B. 6x50mm und 6x60 mm, aber nicht z.B. 5,8x51,3 mm.)

Das Interessante an dieser Aufgabe ist die Arbeit mit der Photobox zum automatisierten Erstellen von qualitativ hochwertigen Bildern, die Erkennung von Längen und gegebenenfalls die Ausgabe von mehreren Lösungen bei leicht zu verwechselnden Teilen.

Da wir hier unterschiedliche Ansätze verfolgen können, wird diese Aufgabe eventuell von mehreren Teams bearbeitet.

2. Themengebiet: Erkennung von Warnsignalen für eine visuelle Hörhilfe

Am Fachbereich haben wir kürzlich eine Hörhilfe entwickelt für Personen mit eingeschränktem Richtungshören [1] (Paper, Präsentation).

Bisher werden Schallquellen visuell angezeigt, aber bei der Visualisierung nicht unterschieden. Im Straßenverkehr sind manche Schallquellen spezifiziert, insbesondere die Sondersignale der Einsatzfahrzeuge. Polizei, Rettungswagen und Feuerwehr haben neben dem Blaulicht auch ein Folgehorn (Martin-Horn), die Polizei in manchen Bundesländern auch seit neuerem auch das ‚Yelpsignal‘ das zum Anhalten auffordert. Daneben gibt es Hupen, das Klingeln der Straßenbahn und das Knacken der Fußgängerampeln. Unsere visuelle Hörhilfe arbeitet mit einem kreisförmigen Mikrofonarray und einer Library, die die eigentliche Richtungserkennung durchführt, hinzuzufügen ist die Klassifikation der Signale.

- Verstehen der Spezifikation der Tonsignale von Einsatzfahrzeugen, insbesondere Land/Stadthorn, Yelp

- Verstehen von Zeitsignal vs. Frequenzspektrum

- Datensammlung aus Onlinequellen, z.B. Youtube

- Entwickeln dedizierter Filter / Training von Hidden-Markov-Modellen (HMM) oder künstlicher Neuronaler Netze (KNN)

- Einschätzen der Alternativen bezüglich benötigter Rechenleistung (Hörhilfe ist ein batteriebetriebenes Embedded-Gerät)

- gegebenenfalls Test in der Nähe des Krankenhauses oder einer Polizeiwache

- Erweiterung zu Straßenbahnklingeln, Hupen, Fahrradklingel, Knacken der Fußgängerampel

3.Themengebiet: Erkennung von unterschiedlichen Schallquellen für eine visuelle Hörhilfe

Dieses Themengebiet ist ähnlich zum zweiten Themengebiet, aber wir konzentrieren uns eher auf Situationen in Innenräumen und nicht-verkehrsbezogene Geräusche: Männerstimme, Frauenstimme, Kinderstimme, Hundebellen, Babyschreie.

Wir verwenden für diese Aufgabe existierende Datensammlungen und lernen insbesondere deren Aufbereitung und die Teilnahme an Evaluationen. Relevante Datensammlungen sind DCASE2017 (Task 2, Task 3) und Datensammlungen für unterschiedliche Sprachen vom Linguistic Data Consortium. Wir folgen den Regeln der Tasks, suchen uns aber zur Hörhilfe passende Domänen heraus. Wir messen uns an den Ergebnissen von Forschungsteams und versuchen gegebenenfalls deren Ergebnisse zu reproduzieren oder zu verbessern.

4. Themengebiet: Akustische Drohnendetektion

Wir verwenden unsere kleinen Indoor-Drohnen (Crazyflie 2.0) und unsere Positionierungssysteme (per Funk oder optisch), um im Labor bestimmte Flugkurven zu absolvieren. Die Datensammlung besteht aus der simultanen Aufnahme der Drohnengeräusche von mehreren Mikrofonarrays. Aus den akustischen Daten soll die Flugbahn rekonstruiert werden. Anwendungsszenario ist die Simulation eines akustischen Flughafenschutzes im Kleinen.

- Einarbeitung in das Tracking-System und die Crazyflies

- Erstellung einer beschränkten Anzahl von Flugbewegungen

- Datensammlung mit mehreren Mikrofonarrays

- End-to-End-Learning aus (bekanntem) Ort der Drohne und den Audiosignalen

- Auswertung der Genauigkeit der Ortsvorhersage

[1] Udo Gebelein, Stefan Rapp (2020) “A Hearing Aid to Visualize the Direction of Sound”, ESSV 2020, 31st Conference on Electronic Speech Signal Processing, March 4–6, Magdeburg, Germany.

FaSTDa Racing-Team

Wintersemester 2019/20

Im Bachelorprojekt Systementwicklung geht es diesmal um Pilonenerkennung und Fahrspurregelung. Hintergrund ist, dass unser FaSTDa Racing-Team bei Wettbewerben bald auch autonom fahren muss.

Multimedia Billiard Table

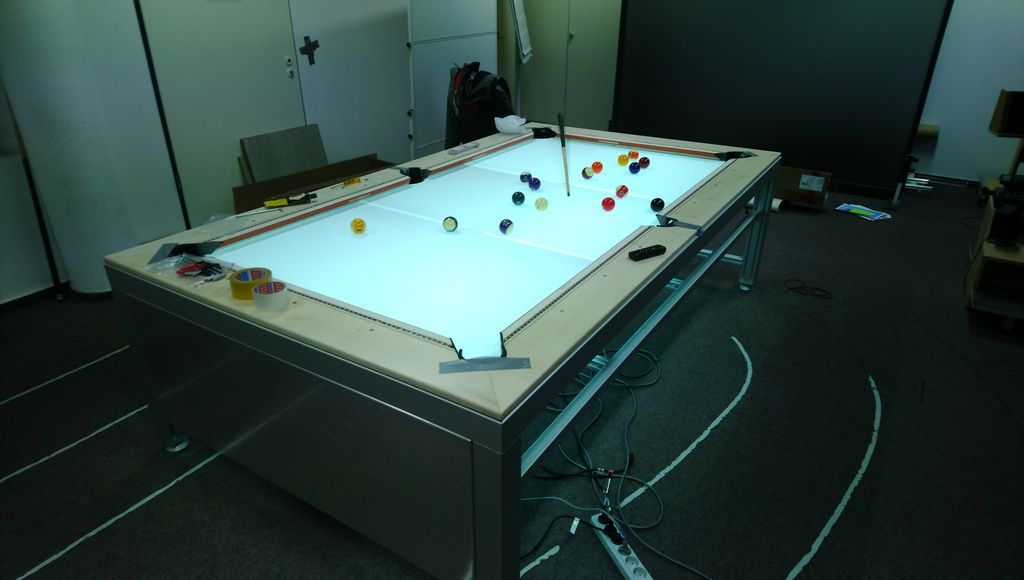

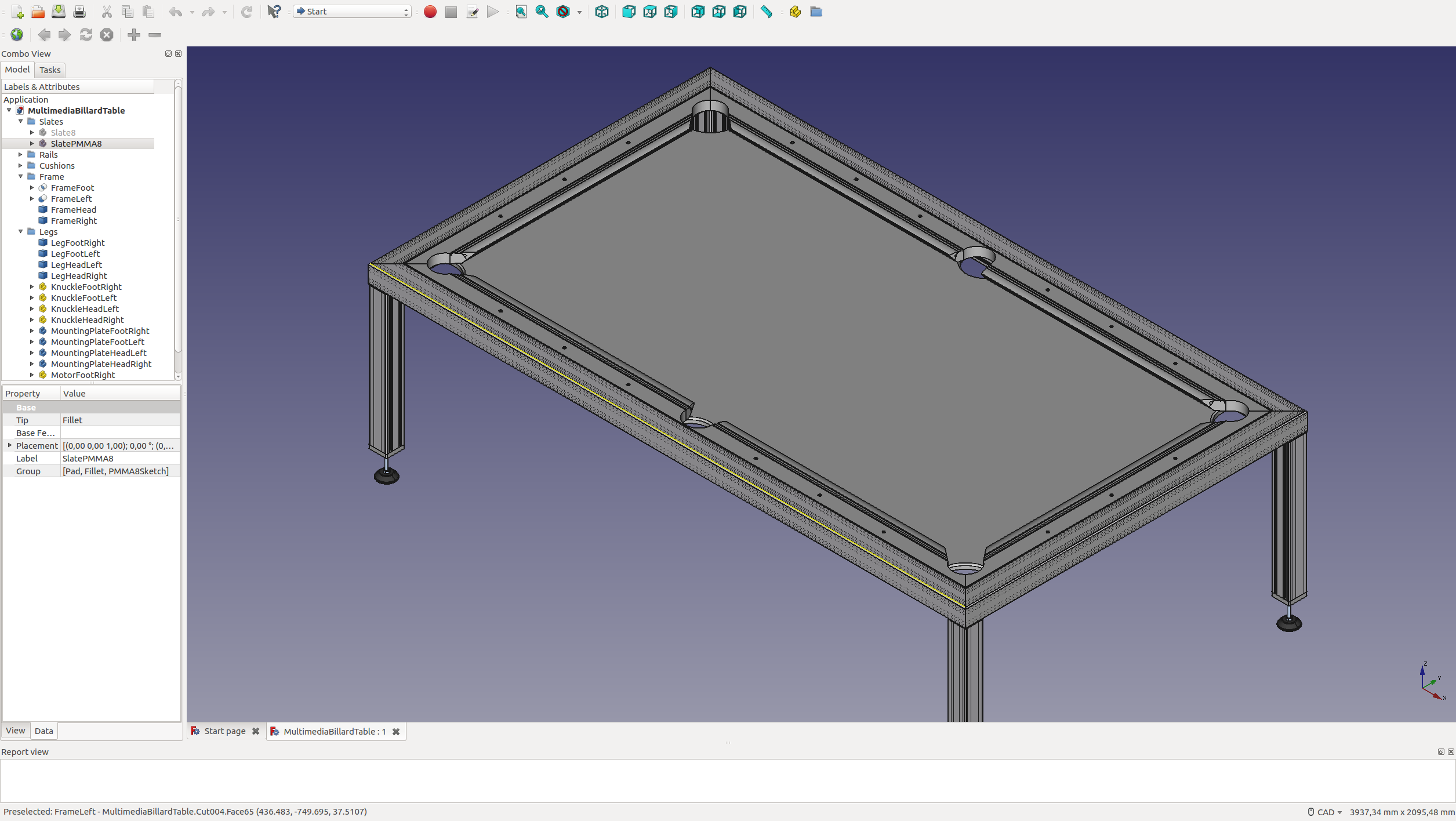

Ziel des Projektes ist die Konstruktion und Programmierung eines interaktiven Billardtischs. Das Projekt wird von Björn Frömmer, Stefan Rapp und Elke Hergenröther betreut.

Wintersemester 2019/20 und Sommersemester 2020

In diesem Semester macht Björn Frömmer das BPSE Multimedia Billiard Table alleine weiter -- Achtung, bei der richtigen Lehrveranstaltung anmelden!

Sommersemester 2019

Im Sommersemester wollen wir auf die Ergebnisse des letzten Semesters aufbauen, bei dem die Tisch-Hardware zum größten Teil aufgebaut wurde und eine initiale Fassung der Softwarekomponenten erstellt wurde.

Mögliche Aktivitäten sind:

- Neue Visualisierungen auf der Projektionsfläche

- Berechnung der Abprall- und Kollisionswinkel, Vorschlag von einfachen Spielzügen

- Verdrahtung der LED in den Diamanten

- Integration der Kugelpositionserkennung im Tisch (statt mittels Kamera von der Decke)

- Automatische Höhenanpassung und Nivellierung des Tisches

- Konvertierung in einen Meetingtisch (Abdeckung und automatische Höhenangleichung)

- Gesamtsystemstart

- Allgemeine Verbesserungen aller Komponenten

- Veröffentlichung als Open-Source-Projekt

- Vorbereitung als Ausstellungsobjekt auf der Hobit im Januar 2020

Die genauen Arbeitsinhalte werden wir zu Beginn des Semesters gemeinsam festlegen. Auch die Teilnehmer dürfen gerne eigene Ideen beisteuern!

Ein Besuch der Abschlussveranstaltung des Teams vom Wintersemester am 28.03.2019 um 15:00 in D15/1.07 ist dringend erforderlich.

Wintersemester 2018/19

Ziel des Projektes ist die Konstruktion und Programmierung eines interaktiven Billardtischs. Ein ähnliches Projekt kann hier angesehen werden. Das Projekt wird von Björn Frömmer, Stefan Rapp und Elke Hergenröther betreut.

Bei unserem Billardtisch wollen wir Rückprojektion einsetzen, das heißt von unten auf das Billardtuch projizieren. Anstatt der Schieferplatte wollen wir eine Plexiglasplatte einsetzen. Der Tisch soll multifunktional nutzbar sein, da wir keinen Raum dauerhaft damit belegen können. Erste Überlegungen zum Hochklappen und dann zur Seite schieben wurden als zu komplex/zu gefährlich verworfen, stattdessen folgen wir vom Mindset dem "fusion table" aus Belgien (https://www.fusiontables.com). Bei diesem Tisch ist der Billardtisch normalerweise nicht zu sehen und sieht wie ein Esstisch aus. Auf uns übertragen wollen wir einen Meetingraumtisch zum Billardtisch konvertieren - Tischplatte abheben und auf Billardhöhe anheben (lassen).

Vom Content her fangen wir vielleicht einfach an, z.B. unterschiedliche Farbe dafür, wer an der Reihe ist, Bling Bling und (Sound-)Effekte. Dann Unterstützung beim Bandenspiel, Unterstützung bei Effet, Stopball. Zum Schluss dann Artistic Pool, bei dem von unten die Aufgaben projiziert werden (und gegebenenfalls überwacht), siehe http://www.artisticpoolplayers.com/shot_programs/ArtisticPool2012.pdf. Wir werden in diesem Semester sicherlich nicht alle Ideen umsetzen können.

Als Implementierung ist ein verteiltes Systen aus einzelnen Komponenten angedacht, die sich über MQTT austauschen. MQTT ist vergleichsweise einfach zu implementieren und man kann noch nicht fertige Teile leicht simulieren. Die entwickelte Software von unterschiedlichen Teilteams ist nur lose gekoppelt.

Die Visualisierungen auf dem Spielfeld werden am PC erzeugt. Welche Visualisierungen, Spielideen etc. das im Einzelnen sind, wird gemeinsam erarbeitet. Beispiele: Aura um Bälle (Flammen, Wirbel, Particles), unterstützende/irritierende Muster (Handicap), Vorhersagen, was passieren wird, Telebillard (courtesy Steffen Czerwinski), bei dem der entfernte Spieler die Bälle dem Projektorbild des anderen Spielers nachlegen muss und dann seinen Stoß durchführt.

Vorraussetzung zur Teilnahme: Erfahrungen und Interesse an Computergraphik (idealerweise Vorlesung Computergraphik schon gehört), Embedded-Systeme, Linux für Raspberry Pi, Softwareentwicklung in C/C++, physikalische Grundkenntnisse (Impuls).

Unser Tisch wird im Semester aufgebaut und besteht aus einem Aluminumgestell und ahorngefassten Banden. An den Nuten der Aluprofile wird unsere Hardware (Projektor, Kameras,...) befestigt.

In jeder Tasche soll ein kleiner Raspberry Pi Zero W mit Kamera stecken, also insgesamt 6 Stück, unter oder auf Plattenniveau. Diese schauen, welche Kugel da eben in die Tasche fiel. Raspi-Kamerabilder können direkt ohne extra Speichertransfer im OpenGL-Shader verarbeitet werden, ein HSV-Converter und Kugelfarbenklassifikator sollte vollparallel in der Graphikhardware realisierbar sein. Beispielsoftware für die Verarbeitung von Kamerabildern im Shader gibt es (raspistill).

Die Diamanten am Rand wollen wir mit RGB-LEDs realisieren, auch von einem der Raspberry Zero gesteuert, und lauschen auf MQTT-Messages. Zur weiteren Aufbereitung der Anzeigemöglichkeiten werden LED-Streifen mit einzeln digital addressierbaren LEDs unter das Tuch eingelassen, das die Bande abdeckt. Damit kann z.B. dem Nutzer eine Position an der Bande feiner visualisiert werden als mit den Diamanten.

Zur Höhenansteuerung (Umstellen von Meetingtisch auf Billardtisch) wird ein weiteres Embedded-System geplant, das außerdem das Ausnivellieren des Tisches übernimmt. In den Beinen integrierte Getriebemotoren drehen die Drehtellerfüße heraus und sorgen so für die Anhebung auf Spielhöhe in endlicher Zeit und das Ausnivellieren mit Hilfe von MEMS-Accelerometern. Während des Hochfahrens darf nichts kippeln, was bei vier Beinen nicht trivial ist.

Kontakt

Kommunikation

Schöfferstraße 10

64295 Darmstadt

Büro: D19, 2.09B

+49.6151.533-68444

stefan.rapp@h-da.de

1

Sprechstunde

nach Vereinbarung (per Email)

Aufgrund technischer Probleme ist derzeit die telefonische Erreichbarkeit meiner Nummer an der Hochschule stark eingeschränkt. Sie erreichen mich gerne auch unter meiner Nummer zuhause 0731 94024786 oder per email.